Daftar Isi

- cara membuat robots.txt yang tepat: Panduan Lengkap

- Memahami Fungsi Dasar robots.txt

- Langkah‑langkah cara membuat robots.txt yang tepat

- Struktur Sintaks Dasar

- Penggunaan Direktif Penting

- Contoh Praktis untuk Situs E‑Commerce

- Tips Menghindari Kesalahan Umum

- Pengujian dan Validasi

- Integrasi dengan Sitemap

- Advanced: Mengatur Crawl‑Delay dan Direktif Khusus

- Studi Kasus: Menghindari Penalti Google

Jika Anda seorang webmaster atau pemilik situs, pasti pernah mendengar tentang file robots.txt. Meskipun ukurannya hanya beberapa baris teks, file ini berperan penting dalam mengarahkan mesin pencari ke bagian‑bagian situs yang seharusnya di‑indeks dan yang tidak. Tanpa konfigurasi yang tepat, Anda bisa kehilangan trafik berharga atau bahkan berisiko terkena penalti.

Pada artikel ini, kami akan membahas cara membuat robots.txt yang tepat secara menyeluruh. Mulai dari konsep dasar, contoh sintaks, hingga tips lanjutan untuk mengoptimalkan file Anda. Semua penjelasan disajikan dalam bahasa yang santai namun tetap profesional, sehingga mudah dipahami oleh pemula maupun ahli SEO.

cara membuat robots.txt yang tepat: Panduan Lengkap

Memahami Fungsi Dasar robots.txt

File robots.txt adalah bagian dari protokol Robots Exclusion Protocol (REP). Ia memberi tahu crawler (bot) mesin pencari apa yang boleh dan tidak boleh di‑crawl pada situs Anda. Dengan menuliskan aturan yang jelas, Anda dapat:

- Mencegah pengindeksan konten duplikat.

- Melindungi area sensitif seperti folder admin.

- Menghemat crawl budget, terutama untuk situs besar.

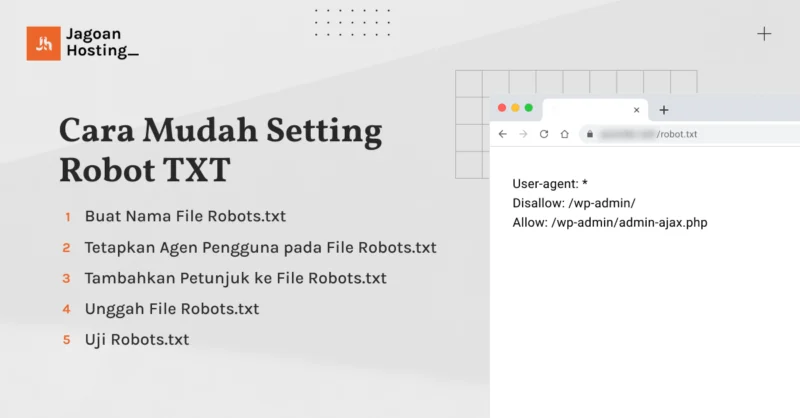

Langkah‑langkah cara membuat robots.txt yang tepat

Berikut urutan yang sebaiknya Anda ikuti:

- Tentukan Tujuan: Identifikasi halaman atau folder mana yang ingin Anda blokir atau izinkan.

- Buat File: Gunakan teks editor sederhana (misalnya Notepad) dan simpan dengan nama

robots.txtdi root domain (contoh:https://contoh.com/robots.txt). - Tulis Aturan: Gunakan sintaks

User-agent,Disallow,Allow, danSitemap. - Uji Coba: Manfaatkan Google Search Console atau tool robots.txt tester untuk memastikan tidak ada kesalahan.

- Publikasikan: Upload file ke server, kemudian cek kembali melalui browser (misalnya

https://contoh.com/robots.txt).

Struktur Sintaks Dasar

Berikut contoh paling sederhana yang menggambarkan cara membuat robots.txt yang tepat:

User-agent: * Disallow:

Baris di atas memberi sinyal kepada semua bot (*) bahwa tidak ada bagian yang diblokir, sehingga seluruh situs dapat di‑crawl.

Penggunaan Direktif Penting

Berikut beberapa direktif yang sering dipakai dalam cara membuat robots.txt yang tepat:

User-agent: Menentukan bot mana yang terpengaruh.Disallow: Menolak akses ke path tertentu.Allow: Mengizinkan akses ke sub‑folder meskipun folder induknya diblokir.Sitemap: Menyertakan URL peta situs untuk memudahkan indexing.

Contoh Praktis untuk Situs E‑Commerce

Sebuah toko online biasanya memiliki folder /cart, /checkout, dan /admin yang tidak perlu di‑crawl. Berikut contoh cara membuat robots.txt yang tepat untuk skenario tersebut:

User-agent: * Disallow: /cart/ Disallow: /checkout/ Disallow: /admin/ Allow: /public/ Sitemap: https://tokoonline.com/sitemap.xml

Tips Menghindari Kesalahan Umum

Kesalahan pada file robots.txt dapat berakibat fatal. Berikut beberapa hal yang perlu diwaspadai saat cara membuat robots.txt yang tepat:

- Jangan blokir seluruh situs secara tidak sengaja. Pastikan ada setidaknya satu

Allow:atau tidak menuliskanDisallow: /jika ingin semua terindeks. - Perhatikan kapitalisasi. Beberapa server bersifat case‑sensitive, jadi

/Admin/berbeda dengan/admin/. - Gunakan komentar dengan tanda

#untuk memberi penjelasan pada diri sendiri atau tim.

Pengujian dan Validasi

Setelah Anda menyiapkan file, langkah selanjutnya dalam cara membuat robots.txt yang tepat adalah mengujinya. Google Search Console menyediakan fitur robots.txt Tester yang memungkinkan Anda memeriksa apakah aturan sudah bekerja sebagaimana mestinya. Cukup masukkan URL file, pilih User-agent yang diinginkan, dan lihat apakah URL tertentu di‑allow atau di‑disallow.

Jika Anda menemukan masalah, perbaiki file dan upload kembali. Proses iteratif ini penting untuk memastikan tidak ada halaman penting yang terblokir secara tidak sengaja.

Integrasi dengan Sitemap

Menambahkan baris Sitemap: di dalam file robots.txt merupakan bagian penting dalam cara membuat robots.txt yang tepat. Ini memberi sinyal kepada mesin pencari tentang lokasi peta situs, sehingga mereka dapat menemukan konten baru lebih cepat. Contohnya:

Sitemap: https://contoh.com/sitemap_index.xml

Advanced: Mengatur Crawl‑Delay dan Direktif Khusus

Beberapa bot mendukung Crawl-delay, yang memberi instruksi menunggu beberapa detik sebelum mengakses halaman berikutnya. Ini berguna bila server Anda memiliki kapasitas terbatas. Misalnya:

User-agent: Bingbot Crawl-delay: 10 Disallow: /private/

Perlu diingat, Google tidak memperhatikan Crawl-delay, jadi gunakan hanya untuk bot lain bila diperlukan.

Studi Kasus: Menghindari Penalti Google

Jika Anda belum familiar dengan cara menghindari penalti Google, artikel tersebut dapat menjadi referensi tambahan. Pada dasarnya, cara membuat robots.txt yang tepat membantu Anda mengontrol apa yang di‑crawl, sehingga mengurangi risiko konten duplikat atau over‑crawling yang dapat menurunkan peringkat.

Berikut rangkuman cepat yang dapat Anda gunakan sebagai checklist:

- File berada di root domain.

- Gunakan

User-agentyang jelas. - Hindari

Disallow: /kecuali memang ingin seluruh situs tidak di‑crawl. - Sertakan

Sitemap:yang akurat. - Uji dengan Google Search Console.

Dengan menerapkan semua langkah di atas, Anda telah menguasai cara membuat robots.txt yang tepat dan siap meningkatkan performa SEO situs Anda. Ingat, file ini bukan sekadar teks biasa, melainkan instrumen strategis yang dapat mempengaruhi visibilitas di mesin pencari.

Selamat mencoba! Jika Anda menemukan kendala atau ingin memperdalam topik, jangan ragu untuk membaca artikel terkait lainnya di situs kami.

Artikel ini dipublikasikan oleh Media Kampung.

Tinggalkan Balasan